⚡️ 核心洞察 (Core Insights)

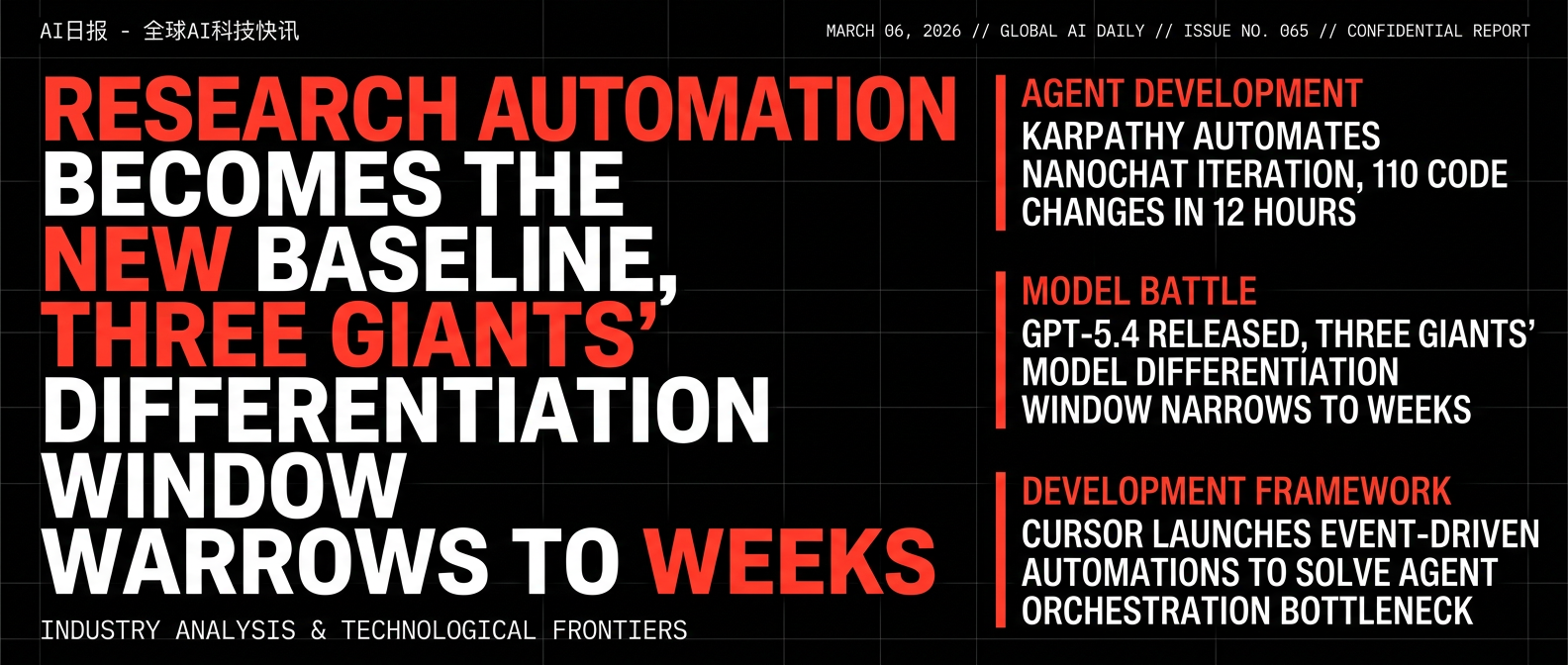

- Karpathy 将 AI Agent 接入 nanochat 训练循环,宣告「研究本身的自动化」成为新基准——真正的 benchmark 不再是模型跑分,而是「哪个 Agent 编排方案能最快改进训练代码」。

- GPT-5.4 发布验证「三巨头收敛假说」——OpenAI/Anthropic/Google 每次发布即最强,直到对手下一轮迭代,形成自我实现的军备螺旋;模型差异化窗口正在收窄至数周。

- Agentic 工作流的瓶颈已从模型智能转移到 Compute 经济学与人类注意力——Cursor Automations 的核心卖点不是 Agent 更聪明,而是用事件驱动取代人类轮询,解决「一个人管不了 10 个 Agent」的注意力破产问题。

🛠 技术演进与工程实践 (Engineering & Tech Stack)

A. GPT-5.4 与模型选择困境

- 核心论点:GPT-5.4 统一了此前碎片化的模型线(类似微软 Office 命名混乱),官方建议几乎对所有任务使用「GPT-5.4 + Extra High thinking」。

- 关键细节:

/fast模式速度显著提升,接近 Claude Code 的响应节奏(@steipete、@alex_prompter 证实)。- 1M context window 默认未开启,需手动编辑

config.toml——OpenAI 将此细节埋在文档深处(@alex_prompter)。 - Token 消耗剧增:一次复杂重构烧掉 5 小时周限额的 20%(@alex_prompter)。

- GDPval benchmark 显示 GPT-5.4 在专业任务中 82% 的场景追平或超越人类专家;7 小时任务预计平均节省 4 小时 38 分(@emollick)。

- KOL 观点对撞:@manthanguptaa 明确表示「不喜欢 Opus 4.6,已完全切换 GPT 5.3 Codex,等待 Opus 5」;@vasuman 更直接——「Anthropic 对 Claude Code 做了 lobotomy(阉割),可能因每次调用都在亏钱」,甚至呼吁「给 Claude 加广告我也无所谓,只要能恢复 200 IQ 的 Opus」。@emollick 则维持中立:三家最新模型都非常好,差异需要专业知识才能辨别。

B. Claude Code 工程实践:Ultrathink 与 18 条硬核技巧

- 核心论点:

ultrathink关键词回归 Claude Code——在 prompt 中任意位置插入即可将 thinking effort 从默认 Medium 提升至 High,适合复杂推理任务(@Shpigford、@svpino 确认)。 - @svpino 在 Sonar Summit 分享的关键技巧(精选):

- 始终用

@filename.py/@src/classes/约束 Agent 上下文范围。 - CLAUDE.md 中写入规则:「改动超过 3 个文件时,先停下拆分成小任务」。

- 创建

/decompose命令,将计划自动分解为可逐步执行的任务列表。 - 遇 Bug 先写复现测试,再修复——引导 Agent 进入 TDD 循环。

- 使用

.claudeignore隔离敏感或无关文件。 /memory持久化个人偏好,跨项目生效。

- 始终用

C. Cursor Automations:事件驱动的 Agent 编排

- 核心论点:Cursor 推出 Automations,与 OpenAI Codex(Automations)和 Claude Cowork(Scheduled Tasks)的关键区别在于外部事件触发而非定时调度(@Shpigford、@LiorOnAI)。

- 关键细节:

- PR merge → 自动安全审计;PagerDuty 告警 → Agent 查日志出修复方案;Cron → 每日测试覆盖率检查。

- 每个 Automation 运行在隔离云沙盒中,通过 MCP 协议接入 Slack/Linear/GitHub/Datadog 等工具。

- Agent 具备 built-in memory,可从历次运行中学习。

- Cursor 内部每小时运行数百个 Automation,安全审计 Agent 在不阻塞 PR 的前提下捕获了多个漏洞。

D. Karpathy 的 nanochat:Agent 自动迭代训练代码

- 核心论点:nanochat 现在在单个 8×H100 节点上 2 小时训练完 GPT-2 级模型(一个月前约 3 小时),且 AI Agent 已接入自动迭代循环——12 小时内完成 110 次代码变更,validation loss 从 0.862415 降至 0.858039,无 wall clock 回归(@karpathy)。

- 关键细节:

- 数据集从 FineWeb-edu 切换到 NVIDIA ClimbMix 带来最大提升(Karpathy 对 goodharting 有轻微怀疑但认为论文方法合理)。

- Karpathy 明确提出新 meta:「真正的 benchmark 是——哪个研究 org 的 Agent 代码能最快改进 nanochat?」

- 长期记忆方向:Karpathy 认为当前 memory 实现(compaction 等)是粗糙的早期方案,更理想的路径是将 memory ops 作为 tools 纳入 RL 优化;更激进的方向是基于权重更新的长期记忆(猜测人类可能在睡眠中执行此类更新),但这属于「established prod stack 之外的研究领域」。

E. Liquid AI LFM2-24B-A2B:On-Device Agent 的工程里程碑

- 核心论点:24B 参数模型,仅 2.3B 参数/token 激活(MoE 式稀疏),14.5GB 显存,M4 Max 上 385ms 完成 tool-calling(@LiorOnAI)。

- 架构细节:Convolution blocks + Grouped Query Attention 以 1:3 混合,通过 hardware-in-the-loop search 直接在目标芯片上优化架构。

- 工程意义:合规行业(金融/医疗)可在离线笔记本上运行 Agent,数据不出设备;开发者可零 API 延迟原型化 multi-tool 工作流。

F. DeepMind Social Meta-Learning & Meta 结构化验证

- Social Meta-Learning(@rryssf_):借鉴发展心理学,训练 AI 从「被纠正」中学习;在数学纠错上训练后,编程反馈学习能力也提升——跨域迁移。

- Meta 的 Structured Verification(@alex_prompter):让 LLM 在给出 yes/no 前,必须填写结构化 checklist(展示推理步骤 + 每个 claim 的 evidence)。无需 fine-tuning,无需新架构,代码 patch 验证错误率降低近一半。

G. MCP Toolbox for Databases

- 核心论点:Google 开源的 MCP Server,让 AI Agent 安全高效地与 SQL 数据库交互(@Sumanth_077)。

- 关键特性:声明式工具定义(<10 行代码集成)、内置连接池、OpenTelemetry 可观测性、支持 PostgreSQL/MySQL/Cloud SQL/AlloyDB。

📈 产业格局与商业逻辑 (Industry & Strategy)

- Compute 瓶颈已成现实:@emollick 明确指出「Agentic 工作流的 token 需求极高,前沿 Agent 只在高价值任务上才有正 ROI」。数据中心融资安排的风险他无法评估,但从实际算力需求看,「没有泡沫——算力一旦上线就会被迅速消耗」。

- 三巨头收敛与自我实现的加速螺旋:@emollick 提出「Big Three 假说」——OpenAI、Anthropic、Google 在相似路径上以相似节奏前进,这种同步性本身构成加速的自我实现预言。其他玩家(如 Meta、xAI)并不总能维持这一节奏。

- Icon AI Admaker 破产:花 $12M 买域名的 AI 广告公司倒闭(@levelsio),印证 AI 应用层「有流量无壁垒」的死亡模式。

- Sakana AI × 三菱 UFJ 银行:「AI 融资专家」进入实案件验证阶段(@hardmaru),标志自主研究 Agent 技术栈(The AI Scientist)从论文走向金融实务。

- Anthropic 用户增长:Claude 日新增注册超 100 万(@bcherny 转引 @mikeyk)。但 @vasuman 提出尖锐反驳:如果模型被降智以控制成本,用户量的增长将以质量为代价;他认为 99% 的用户会接受「看广告换最强模型」的交易。

- Levelsio 的反直觉验证:单个 40,870 行 PHP 文件(index.php),$105K/月营收、$80K/月利润,页面渲染 44ms。这不是技术范式而是商业范式——极端简单架构 + 个人运营 = 超高利润率。

📎 值得关注的「信号」(Under-the-Radar Signals)

- OLMo Hybrid 7B(Allen AI):开源 7B 模型击败自家同规模 Transformer,采用混合架构——可能预示 Transformer 之外的架构竞争进入实用阶段(@LiorOnAI 转引 @AlphaSignalAI)。

- HuggingFace Hub Buckets(v1.5.0):类 S3 存储原生集成 Hub,无 git 历史,纯快速分块上传——这是 HF 从「模型仓库」向「AI 基础设施层」扩张的关键一步(@_akhaliq 转引 @Wauplin)。

- Tencent HY-WU:「可扩展功能性神经记忆框架」及其在 text-guided image editing 上的实例化——记忆(Memory)作为独立可组合模块的架构思路值得追踪(@_akhaliq)。

- CubeComposer:从透视视频生成 4K 360° 全景视频的时空自回归方法——若成熟,将颠覆 VR/空间视频内容生产成本(@_akhaliq)。

🧐 今日金句 (Hardcore Quotes)

@karpathy:「真正的 benchmark 是:哪个研究组织的 Agent 代码能最快地改进 nanochat?这就是新的 meta。」

——研究的度量标准本身正在被重新定义:不是模型跑多少分,而是「自动化研究管线」的迭代速度。当 AI Agent 开始优化训练 AI 的代码,我们进入了递归改进的早期阶段。